4 Probleme der Künstlichen Intelligenz, die immer noch gelöst werden müssen

KI braucht riesige Datenmengen, um korrekt zu funktionieren

2015 haben Google und Microsoft ihre Bilderkennungsalgorithmen gezeigt, die das Identifizieren von Objekten in Bildern von den besten Menschen gelernt hatten. Allerdings haben die Menschen beide Algorithmen gebraucht, um 1,2 Millionen Bilder zu untersuchen. “Ein Kind kann lernen, eine neue Kategorie von Objekten oder Tieren anhand von nur einem Beispiel zu erkennen”, schreibt Tom Simonite, Redakteur der MIT Technology Review.

Neil Lawrence, Professor für Maschinelles Lernen an der University of Sheffield und Leiter der Abteilung für Maschinelles Lernen bei Amazon behauptet dass die KI hunderttausendmal mehr Daten als ein Mensch brauche, um die Bilderkennung zu erlernen.

“Wenn man sich alle Anwendungsdomänen anschaut, in denen das tiefe Lernen erfolgreich war, wird man feststellen können, dass es sich um Domänen handelt, wo viele Daten angesammelt werden können”, sagt Lawrence. Ein Beispiel für die Bilderkennung anführend, betont er, dass die Industrie-Riesen wie Facebook und Google Zugang zu “Datenbergen” hätten, während sie mit der Technologie arbeiten.

Schwierigkeiten ergeben sich demnach aus der Tatsache, dass es in vielen Bereichen schwer ist, große Datenmengen zu akquirieren. Beispielsweise wird die Machine-Vision-Technologie in der Medizin genutzt, um Tumore auf Röntgenbildern erkennen zu können, in einigen Situationen ist es jedoch unmöglich, genügend digitalisierte Informationen zu finden. Lawrence glaubt, dass es nicht die Lösung sein könne, mehr Daten zu sammeln. Der einzige Ausweg ist die Verwendung von Algorithmen, die weniger Ressourcen benötigen.

KI ist nicht multitaskingfähig

Die KI-Algorithmen können momentan nur ein bestimmtes Problem auf einmal lösen. Wie Raia Hadsell, Google-DeepMind-Forscher sagt, könne die KI trainiert werden, Katzen zu erkennen oder Atari-Spiele zu spielen, aber es gebe noch keine Algorithmen, die diese Dinge gleichzeitig tun könnten. Hadsell behauptet, neuronale Netze seien nicht in der Lage, ihre Kompetenzen unbegrenzt zu erweitern. Ständige Änderungen der Algorithmen mache sie unfähig, auf die Änderungen ab einem gewissen Zeitpunkt wegen ihrer Größe zu reagieren.

Bei DeepMind nennen sie es “katastrophales Vergessen”. Wenn die Entwickler der KI zum Beispiel beibringen, menschliche Gesichter zu erkennen, aber dann zu Kühen wechseln wollen, wird die KI die Gesichtserkennung vergessen, um Speicherplatz für neue Informationen freizugeben. Die neuronalen Netze verwenden heutzutage Millionen mathematischer Gleichungen, um Muster zu modellieren, die Gleichungen sind aber so miteinander verbunden und voneinander abhängig, dass sie bei den kleinsten Änderungen an der Aufgabe scheitern, die sie lösen sollten.

Niemand versteht genau, wie KI funktioniert

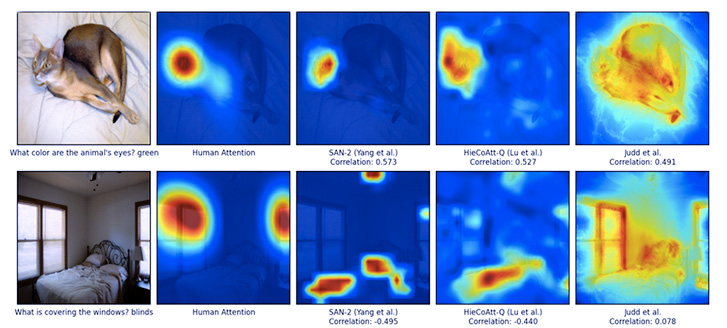

2016 haben die Forscher am Virginia Polytechnic Institute ein Experiment durchgeführt, um zu bestimmen, welchen Bereich sich die KI “anschaut”, um eine Aufgabe zu lösen. Sie haben der KI das Foto eines Schlafzimmers gezeigt und gefragt: “Was bedeckt die Fenster?” Es stellte sich heraus, dass, anstatt sich auf die Fenster zu konzentrieren, die KI zuerst den Boden gescannt hat. Dann hat das neuronale Netz das Bett gesehen und geantwortet: “Jalousien bedecken die Fenster”.

Die KI-Antwort war richtig, aber nur deshalb, weil es nicht genug Daten gab. Das neuronale Netz hat das Bett erkannt und konnte daher feststellen, dass es sich um ein Schlafzimmer auf dem Foto handelt, durch diese Informationen hat sich die Schlussfolgerung ergeben, dass die Fenster von Jalousien bedeckt sind. “Es ist logisch und dumm zugleich. Viele Schlafzimmer haben keine Jalousien!”, kommentiert James Vincent, Redakteur bei The Verge.

Ergebnisse der Studie des Virginia Polytechnic Institute

Der Punkt ist, dass es schier unmöglich ist, ins “Innere” eines neuronalen Netzes zu blicken, um zu verstehen, wie es funktioniert. Die Vernetzung basiert auf dem Verhalten von Tausenden künstlicher Neuronen, die Hunderte ihrer Schichten umfassen.

Ab 2018 kann die Europäische Union Unternehmen verpflichten, ihren Kunden die Entscheidungen der neuronalen Netze zu erklären. “Das könnte unmöglich sein, auch in Bezug auf Systeme, wie Apps und Webseiten, die relativ einfach von der Oberfläche her zu sein scheinen und tiefes Lernen verwenden, um Anzeigen zu platzieren oder Songs zu empfehlen. Die Computer, die diese Dienste ausführen, haben sich selbst programmiert, und sie haben es auf die Art und Weise gemacht, die wir nicht verstehen können. Auch die Ingenieure, die diese Apps entwickelt haben, können ihr Verhalten nicht ganz erklären”, bemerkt Will Knight, leitender Redakteur der MIT Technology Review.

KI-Fähigkeiten sind besorgniserregend

Die potenzielle Macht der KI ist für viele Unternehmer und Wissenschaftler heutzutage ein Angelpunkt. Noch 2014 hat Elon Musk, CEO von Tesla und SpaceX die KI “unsere größte existentielle Bedrohung” genannt: “Mit der Künstlichen Intelligenz fordern wir den Dämon heraus. In all jenen Geschichten, wo der Kerl mit dem Pentagramm und dem heiligen Wasser da ist, heißt es – ja, er ist sich sicher, dass er den Dämon kontrollieren kann. Das klappt vielleicht nicht immer”, sagt Musk.

Seitdem hat sich seine Meinung nicht verändert und wurde sogar von seinen Taten unterstützt. Ende 2015 haben Musk und Sam Altman, CEO von Y Combinator die OpenAI gegründet, eine gemeinnützige Organisation, die untersucht, wie die KI der Menschheit dienen kann.

Der Wissenschaftler Stephen Hawking äußerte ebenfalls seine Sorgen über die Gefahren der KI. Seiner Meinung nach kann die Weiterentwicklung der Technologie sowohl positive als auch negative Konsequenzen wie autonome Waffen, wirtschaftliche Störungen und Konflikte zwischen Menschen und Maschinen haben. “Kurz gesagt, wird der Aufstieg der mächtigen KI entweder das Beste oder das Schlimmste sein, was der Menschheit jemals passieren wird”, so Hawking.

Unter den Befürwortern der potenziellen KI-Gefahren sind der Mitbegründer von Microsoft Bill Gates, der Erfinder des Worldwide Web Tim Berners-Lee und der Apple-Mitbegründer Steve Wozniak. “Wenn wir diese Geräte bauen, damit sie sich um alles für uns kümmern, werden sie schließlich schneller als wir denken und die langsamen Menschen loswerden wollen, um Unternehmen effizienter zu betreiben”, sagte Wozniak.

![Level of Automation Maturity [thumbnail]](/uploads/media/thumbnail-280x222-catching-up-with-hyperatomation-how-to-define-automation-maturity.webp)

![Defender for IoT [thumbnail]](/uploads/media/thumbnail-280x222-how-to-ensure-Iot-and-ot-security98.webp)

![Credit Risk Management Software Development [thumbnail]](/uploads/media/how-to-approach-the-development-280x222.webp)

![Investing in XR [thumbnail]](/uploads/media/thumbnail-280x222-when-invest-in-xr.webp)

![Robotic Invoice Process Automation [thumbnail]](/uploads/media/automating-invoicing-with-rpa-280x222.webp)

![Overview of Connected Banking and its Benefits [thumbnail]](/uploads/media/what-is-connected-banking-its-promises-and-benefits-280x222.webp)

![API Strategy for Banking [thumbnail]](/uploads/media/whys-and-hows-of-api-strategy-for-banking-280x222.webp)

![ESG digitale Lösungen [thumbnail]](/uploads/media/what-is-esg-and-how-to-facilitate-your-sustainability-strategy-with-digital-solutions-280x222.webp)

![Extended Reality for Manufacturing [thumbnail]](/uploads/media/the-place-of-extended-reality-280x222.webp)